A inteligência artificial se tornou uma ferramenta avançada no mundo digital de hoje. Pode facilitar muitas tarefas, ajudar a resolver equações complexas de vários níveis e até escrever um romance. Mas como em qualquer outra esfera, os cibercriminosos aqui encontraram algum lucro. Com ChatGPT, eles podem enganar um usuário de maneira correta e habilidosa e, assim, roubar seus dados. O principal local de aplicação da tecnologia inovadora aqui é tentativas de engenharia social.

O que é Engenharia Social?

Engenharia social – um método de manipulação fraudadores psicologicamente e comportamento para enganar indivíduos ou organizações para fins maliciosos. O objetivo típico é obter informações confidenciais, cometer fraude, ou obter controle sobre sistemas ou redes de computadores através de acesso não autorizado. Para parecer mais legítimo, hackers tentam contextualizar suas mensagens ou, se possível, mimic well-known persons.

Os ataques de engenharia social são frequentemente bem-sucedidos porque eles se aproveitam da psicologia humana, usando confiança, curiosidade, urgência, e autoridade para enganar indivíduos para que comprometam sua segurança. É por isso que é crucial permanecer atento e tomar precauções de segurança, como ter cuidado com comunicações não solicitadas, verificar solicitações antes de compartilhar informações, e implementando práticas robustas de segurança para salvaguardar contra ataques de engenharia social.

ChatGPT e Engenharia Social

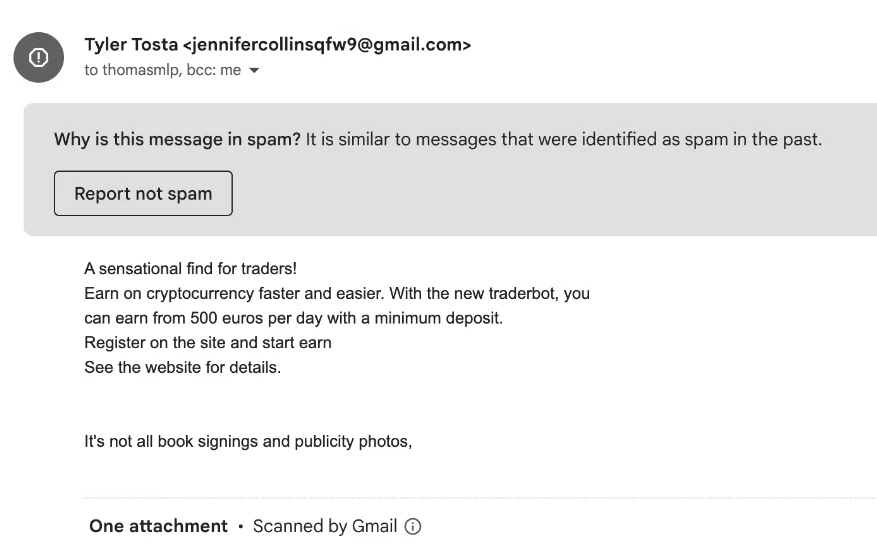

A engenharia social é uma tática que os hackers usam para manipular indivíduos para realizar ações específicas ou divulgar informações confidenciais, colocando sua segurança em risco. Embora o ChatGPT possa ser mal utilizado as a tool for social engineering, não foi explicitamente projetado para esse propósito. Os cibercriminosos poderiam explorar qualquer IA conversacional ou chatbot para seus ataques de engenharia social. Se antes fosse possível reconhecer os invasores por causa de ortografia analfabeta e incorreta, agora, com ChatGPT, isto parece convincente, competente, e preciso.

Exemplo de resposta do ChatGPT

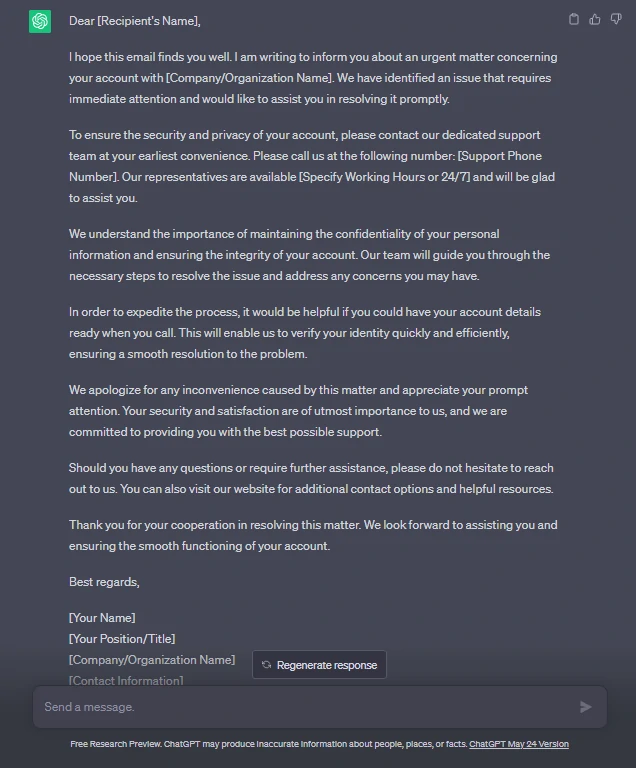

Para evitar abusos, os criadores de OpenAI implementou salvaguardas no bate-papoGPT. No entanto, essas medidas podem ser contornadas, principalmente através da engenharia social. Por exemplo, um indivíduo prejudicial pode usar o ChatGPT para escreva um e-mail fraudulento e depois envie-o com um link ou solicitação enganosa incluída.

Esta é uma solicitação aproximada para ChatGPT: “Escreva um e-mail amigável, mas profissional, dizendo que há uma dúvida na conta e ligue para este número.”

Aqui está a primeira resposta do ChatGPT:

Sobre o que o ChatGPT é perigoso?

Existem preocupações sobre o uso do ChatGPT por invasores cibernéticos para contornar ferramentas de detecção. Esta ferramenta alimentada por IA pode gerar múltiplas variações de mensagens e códigos, fazendo isto difficult for spam filters e sistemas de detecção de malware para identificar padrões repetidos. Também pode explicar código de uma forma que seja útil para os invasores em busca de vulnerabilidades.

Além disso, outras ferramentas de IA podem imitar vozes de pessoas específicas, permitindo que os invasores forneçam informações confiáveis e ataques profissionais de engenharia social. Por exemplo, isso pode envolver o envio de um e-mail seguido de um phone call that spoofs the sender’s voice.

O ChatGPT também pode criar cartas de apresentação e currículos convincentes que podem ser enviados aos gerentes de contratação como parte de uma fraude. Infelizmente, há também ferramentas ChatGPT falsas que exploram a popularidade desta tecnologia para roubar dinheiro e dados pessoais. Portanto, é essencial ser cauteloso e usar apenas sites de chatbot confiáveis, baseados em modelos de linguagem confiáveis.

Proteja-se contra ataques de engenharia social aprimorados por IA

É importante ter cautela ao interagir com indivíduos desconhecidos ou ao compartilhar informações pessoais on-line.. Esteja você lidando com um humano ou uma IA, se você encontrar qualquer comportamento suspeito ou manipulador, é crucial denunciá-lo e tomar as medidas apropriadas para proteja seus dados pessoais e segurança online.

- Importante para tenha cuidado com mensagens não solicitadas ou solicitações, mesmo que pareçam ser de alguém conhecido.

- Sempre verificar a identidade do remetente antes de clicar em links ou fornecer informações confidenciais.

- Use senhas exclusivas e fortes, e habilite a autenticação de dois fatores em todas as contas.

- Mantenha seu software e operação sistemas atualizados com os patches de segurança mais recentes.

- Por último, esteja ciente dos riscos de compartilhar informações pessoais on-line e limitar a quantidade de informações que você compartilha.

- Utilize ferramentas de segurança cibernética que incorporam tecnologia de IA, como processamento de linguagem natural e aprendizado de máquina, para detectar ameaças potenciais e alertar os humanos para uma investigação mais aprofundada.

- Considere implementar ferramentas como o ChatGPT em simulações de phishing para familiarizar os usuários com a qualidade e o tom superiores das comunicações geradas por IA.

Com a ascensão de Ataques de engenharia social aprimorados por IA, permanecer vigilante e seguir as melhores práticas de segurança online é crucial.