Cientistas da Universidade de Boston introduziram um novo algoritmo para proteção contra deepfakes. Seu filtro modifica pixels para que vídeos e imagens se tornem inadequados para falsificações.

Com o desenvolvimento de novas tecnologias de deepfakes, torna-se muito mais difícil determinar a confiabilidade de uma ou outra informação publicada na Internet. Tais tecnologias facilitam a manipulação de imagens e vídeos por meio do uso de redes neurais que podem simular a fala, movimento e aparência.

A respeito disso, um grupo de cientistas da Universidade de Boston, composto por Nataniel Ruiz, Sarah Adel Bargal e Stan Sclaroff, desenvolveu um algoritmo que permite proteger imagens de serem usadas como base para deepfakes.

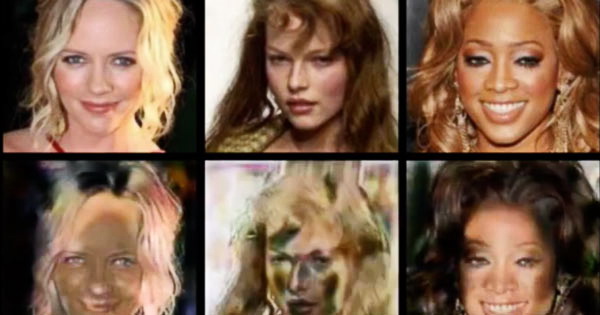

“Dadas imagens do rosto de uma pessoa, tais sistemas podem gerar novas imagens da mesma pessoa sob diferentes expressões e poses. Alguns sistemas também podem modificar atributos específicos, como cor do cabelo ou idade”, - escrevem os cientistas.

O algoritmo impõe um filtro invisível na imagem ou vídeo, e se alguém tentar usar a rede neural para modificar esses arquivos, eles permanecem inalterados ou ficam completamente distorcidos ou borrados, já que o filtro altera os pixels para que o vídeo e as imagens se tornem inadequados para fazer deepfakes.

“Para evitar que um usuário mal-intencionado gere imagens modificadas de uma pessoa sem o seu consentimento, enfrentamos o novo problema de gerar ataques adversários contra tais sistemas de tradução de imagens., que perturbam a imagem de saída resultante. Chamamos esse problema de interrupção dos deepfakes”, - escrevem cientistas da Universidade de Boston.

O StarGAN, GANimação, As redes pix2pixHD e CycleGAN estão incluídas – e os ataques podem ser adaptados a qualquer rede de tradução de imagens.

Algoritmos de desfoque, de acordo com cientistas, pode fornecer proteção bem-sucedida contra destruição e imagens falsas.

Os desenvolvedores do projeto postaram o código-fonte da tecnologia no GitHub, e também publicou um vídeo demonstrando seu trabalho.

Deixe-me lembrá-lo de outro ataque interessante: Botnet MyKingz usa foto de Taylor Swift para infectar máquinas alvo. É improvável que algum algoritmo proteja contra o uso de imagens de celebridades em planos criminosos.